Avis d'experts

Cybersécurité

La cybersécurité dans l’UE est une priorité stratégique pour les années à venir

Natalia García-Barberena

Consultante senior en Projets européens, experte en cybersecurité

Intelligence artificielle

Le projet de cadre réglementaire européen dans ce domaine favorise l’innovation et le respect des normes éthiques

Consultant en Projets européens

Parfois, la fiction n’est pas si éloignée de la réalité. Les films dépeignent continuellement des paradigmes dans lesquels les robots et l’intelligence artificielle finissent par dominer la société ou par transformer la réalité en dystopie. Évidemment, c’est loin d’être le cas, mais il est vrai que l’intelligence artificielle (IA) a évolué rapidement, imprégnant de nombreux aspects de notre vie, révolutionnant les industries et transformant la façon dont nous interagissons avec la technologie.

Cependant, à mesure que les systèmes d’IA deviennent de plus en plus complexes et influents, leur fiabilité suscite des inquiétudes. Des problèmes tels que la partialité, le manque de transparence, la responsabilité et les risques pour les valeurs humaines questionnent le développement et le déploiement responsables de l’IA.

Afin de répondre à ces préoccupations, les gouvernements et les régulateurs du monde entier prennent des mesures, et les institutions européennes ne font pas exception. La semaine dernière, le Parlement européen a adopté sa position de négociation sur un ensemble de règles regroupées dans la loi sur l’IA. Le texte final fera l’objet de discussions avec les États membres, l’objectif étant de parvenir à un accord d’ici la fin de l’année.

Proposée en avril 2021 par la Commission européenne, cette mesure vise à créer un cadre réglementaire harmonisé pour les systèmes d’IA, tout en favorisant l’innovation et en respectant les normes éthiques. Ci-dessous, nous détaillons ses caractéristiques.

La loi classe les systèmes d’IA en quatre niveaux de risque : inacceptable, élevé, limité et minimal. Les systèmes à haut risque, tels que ceux utilisés dans les infrastructures critiques, les soins de santé ou l’application de la loi, seront soumis aux exigences les plus strictes, notamment en matière de transparence, de documentation et de surveillance humaine. En adoptant cette approche, la loi garantit que les mesures réglementaires sont proportionnées aux risques posés par les différentes applications de l’IA, en concentrant les efforts sur les domaines à haut risque tout en autorisant l’innovation dans les domaines à moindre risque.

Cette mesure interdit explicitement certaines pratiques d’IA considérées comme inacceptables en raison de leur potentiel à enfreindre les droits fondamentaux ou à causer des dommages importants. Il s’agit notamment des systèmes qui manipulent le comportement humain ou utilisent des techniques subliminales, ainsi que ceux qui créent des deepfakes à des fins malveillantes. La loi vise ainsi à protéger les droits des personnes et à prévenir l’utilisation abusive de l’IA.

La loi donne la priorité à la transparence et à l’explicabilité afin d’accroître la confiance dans les systèmes d’IA. Elle stipule que les utilisateurs doivent être informés lorsqu’ils interagissent avec l’un d’entre eux, afin qu’ils sachent qu’ils n’ont pas affaire à un être humain, mais à un système automatisé. En outre, les systèmes d’IA à haut risque doivent fournir des informations détaillées sur leurs capacités et leurs limites. Ces exigences permettent aux utilisateurs de prendre des décisions en connaissance de cause et encouragent la responsabilisation quant à l’utilisation des résultats produits par l’IA.

Reconnaissant l’importance de la qualité des données et de l’atténuation des biais, la loi souligne que les données doivent être transparentes et traçables et répondre à certaines exigences de qualité. Elle encourage ainsi l’utilisation d’ensembles de données diversifiés et de grande qualité afin d’éviter les résultats biaisés et la discrimination.

La loi souligne également l’importance de la surveillance humaine. Les systèmes d’IA à haut risque doivent être dotés de mécanismes d’intervention et de contrôle humains adéquats. Cela permet de s’assurer que les décisions cruciales ne reposent pas uniquement sur les algorithmes d’IA et que les humains conservent le contrôle des résultats. Les développeurs et les fournisseurs de systèmes d’IA doivent être tenus responsables de leurs produits. Le non-respect de la loi peut entraîner des amendes importantes, ce qui encourage les développeurs de systèmes d’IA à donner la priorité aux considérations éthiques et à assumer la responsabilité de l’impact social de leurs technologies.

La Commission européenne alloue 317,50 millions d’euros sous forme de subventions pour soutenir des projets innovants dans le domaine de l’IA dans le cadre du cluster 4 du pilier II d’Horizon Europe. Les appels à projets se concentrent sur le développement éthique des technologies numériques et industrielles, où les utilisateurs finaux et les travailleurs sont responsabilisés dans le développement des technologies.

L’objectif de la Commission européenne est de développer un environnement numérique digne de confiance, basé sur un internet plus résilient, durable et décentralisé, de donner aux utilisateurs finaux plus de contrôle sur leurs données et leur identité numérique, et de permettre de nouveaux modèles sociaux et commerciaux qui respectent les valeurs européennes.

L’introduction de la loi européenne sur l’IA représentera une étape importante dans sa réglementation et la garantie de sa fiabilité, car elle vise à protéger les droits des individus tout en favorisant l’innovation et la compétitivité en Europe. Le chemin vers une IA digne de confiance ne s’achèvera toutefois pas avec l’adoption de ces règles. Il reste encore quelques étapes à franchir, qui sont détaillées ci-dessous.

En prenant ces mesures, nous pouvons favoriser un écosystème d’IA fiable qui profite aux individus, aux organisations et à la société dans son ensemble. La Loi sur l’IA de l’UE constitue une base, mais des efforts collectifs et un engagement continu sont nécessaires pour surmonter les difficultés et faire en sorte que cette technologie reste une force positive. Ensemble, nous pouvons façonner son avenir, en donnant la priorité aux valeurs humaines, à l’équité et à la transparence, en inspirant confiance dans cette technologie qui est en train de remodeler notre monde.

Siège de Pampelune

Consultant en Projets européens

Avis d'experts

Cybersécurité

Natalia García-Barberena

Consultante senior en Projets européens, experte en cybersecurité

Avis d'experts

Financement extérieur

Paola Votta

Responsable du domaine d’expertise Pays tiers - Projets européens

Avis d'experts

Margherita Volpe

Responsable du domaine d’expertise Sécurité, Espace et Défense - Projets européens

Actualités

Intelligence artificielle

Avis d'experts

Cybersécurité

Natalia García-Barberena

Consultante senior en Projets européens, experte en cybersecurité

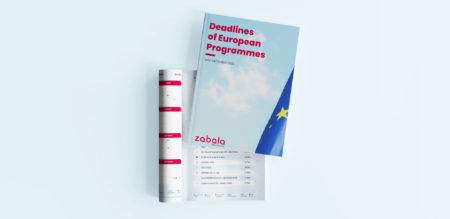

Publications sectorielles

INNOVATION

Voici notre calendrier avec les dates butoir de tous les programmes européens les plus intéressants

Ce site Web utilise des cookies afin que nous puissions vous offrir la meilleure expérience utilisateur possible. Les informations sur les cookies sont stockées dans votre navigateur et remplissent des fonctions telles que vous reconnaître lorsque vous revenez sur notre site Web et aider notre équipe à comprendre les sections du site Web que vous trouvez les plus intéressantes et utiles.

Les cookies strictement nécessaires doivent être activés à tout moment afin que nous puissions enregistrer vos préférences en matière de paramètres de cookies.

Ce site web utilise Google Analytics pour collecter des informations anonymes telles que le nombre de visiteurs du site et les pages les plus populaires.

L'activation de ce cookie nous aide à améliorer notre site web

Please enable Strictly Necessary Cookies first so that we can save your preferences!

Ce site web utilise les cookies supplémentaires suivants :

(Dressez ici la liste des cookies que vous utilisez)

Please enable Strictly Necessary Cookies first so that we can save your preferences!